V dnešní době se umělá inteligence stává stále dostupnější a její aplikace se rozšiřují do mnoha oblastí. Program LocalAI je skvělým příkladem toho, jak můžete využít AI přímo na svém zařízení, aniž byste museli spoléhat na cloudové služby. Pojďme se podívat, co tento projekt nabízí a jak ho můžete začít používat.

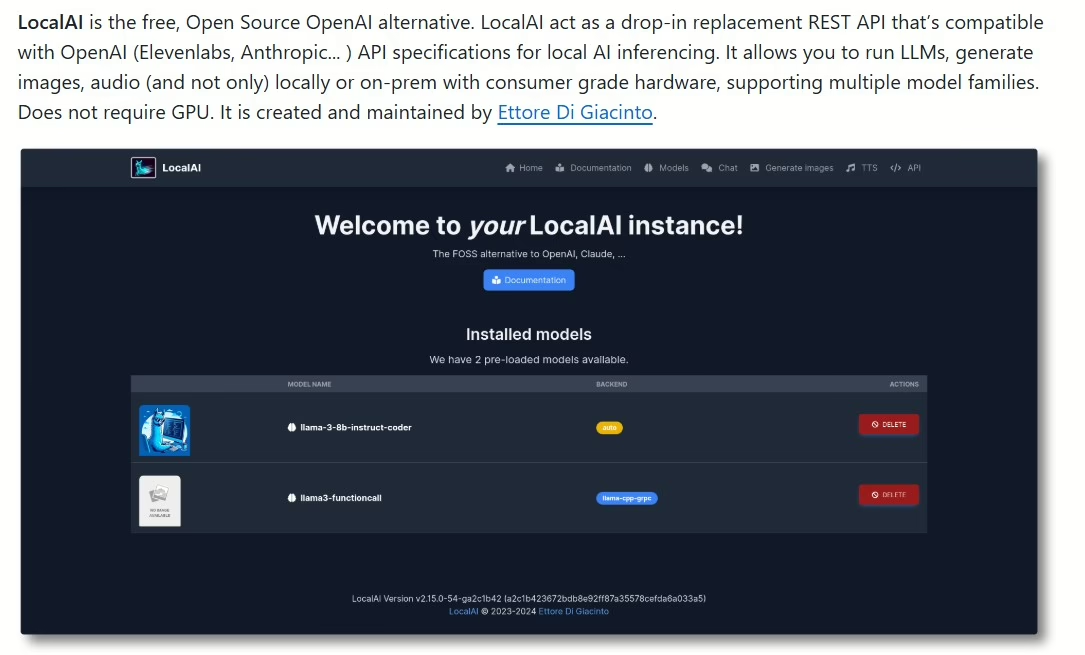

LocalAI je open-source projekt, který umožňuje uživatelům spouštět modely umělé inteligence lokálně na svých počítačích. Tento přístup přináší několik výhod, jako je zvýšená ochrana soukromí a snížení latence při zpracování dat. Místo odesílání citlivých informací na servery třetích stran můžete vše provádět přímo na svém zařízení.

Klíčové vlastnosti

Podpora více modelů: LocalAI podporuje různé modely strojového učení, což znamená, že si můžete vybrat ten, který nejlépe vyhovuje vašim potřebám.

Jednoduché nasazení: Instalace a spuštění LocalAI je snadné. Stačí stáhnout repozitář z GitHubu a řídit se jednoduchými pokyny v dokumentaci.

Flexibilita: Díky možnosti přizpůsobení si můžete upravit nastavení podle svých potřeb a experimentovat s různými parametry modelu.

Jak začít?

Stáhněte repozitář: Navštivte GitHub stránku LocalAI a stáhněte si poslední verzi.

Nainstalujte závislosti: Ujistěte se, že máte nainstalované všechny potřebné knihovny a nástroje pro běh modelu.

Spusťte model: Podle pokynů v dokumentaci spusťte vybraný model a začněte experimentovat.

Tipy pro efektivní použití

Experimentujte s různými modely: Neomezujte se pouze na jeden model. Zkoušejte různé varianty a zjistěte, který z nich vám přináší nejlepší výsledky.

Optimalizujte nastavení: Hrajte si s parametry jako jsou rychlost učení nebo velikost dávky, abyste dosáhli optimálního výkonu.

Sledujte komunitu: Připojte se k diskuzím a fórem kolem LocalAI, abyste získali tipy od ostatních uživatelů a sdíleli své vlastní zkušenosti.

LocalAI je mocný nástroj pro každého, kdo chce využít sílu umělé inteligence přímo na svém zařízení. S jeho pomocí můžete experimentovat s různými modely a aplikacemi AI bez obav o soukromí nebo závislost na externích serverech.

LocalAI podporuje širokou škálu modelů, které pokrývají různé oblasti umělé inteligence. Zde je přehled hlavních kategorií a konkrétních modelů, které můžete využít:

Velké jazykové modely jako jsou LLama, GPT-2, Mamba, RWKV, Falcon, ….

Modely pro převod textu na řeč (Text to Audio) typu piper nebo bark.

Modely pro převod řeči na text (Audio to Text), například whisper.

Modely pro generaci obrazů – stablediffusion.

Stránka projektu https://localai.io/

Quickstart je dostupný na https://localai.io/basics/getting_started/

Github projektu https://github.com/mudler/LocalAI

Aktualizace – duben 2026

Od původního článku uběhl víc než rok a LocalAI se výrazně posunul. Otestoval jsem aktuální verzi a tady jsou praktické zkušenosti.

Co se změnilo

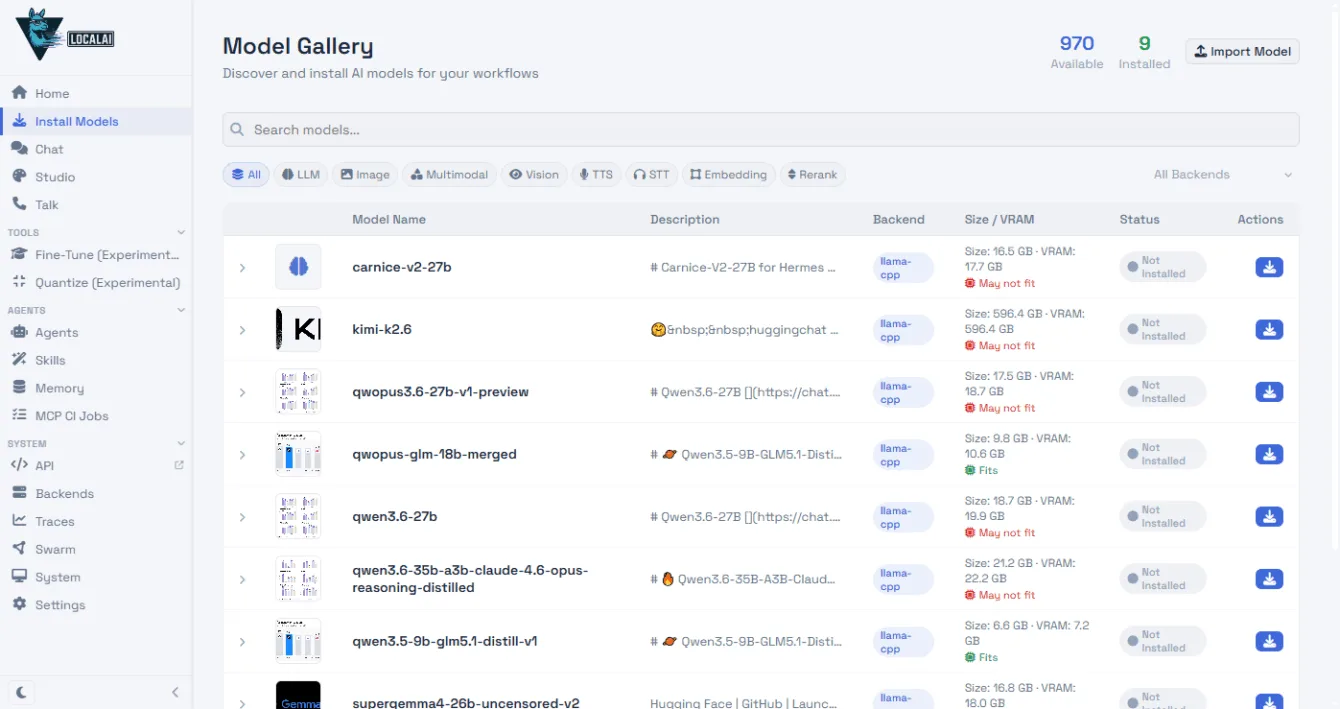

LocalAI dnes vypadá jinak než v lednu 2025. Po spuštění vás přivítá webové rozhraní s chatem a galerií modelů, která rozpozná váš hardware a ukáže, co se na něj vejde.

Kromě textových modelů zvládá generování obrázků, přepis řeči (Whisper), syntézu hlasu a nově i video. Přibyl agentní systém s podporou nástrojů a cluster mode pro rozdělení zátěže mezi více strojů.

Modely, které dnes rozběhnete doma

Výběr open-source modelů se za poslední rok dramaticky rozšířil. Lokálně dnes rozběhnete třeba GPT-OSS 20B od OpenAI (Apache 2.0), Gemma 4 od Googlu nebo Qwen 3.5 s dobrou češtinou. LocalAI v galerii u každého modelu zobrazí požadavky na VRAM a rovnou ukáže, jestli se na vaši grafiku vejde.

Instalace na Windows

LocalAI nemá nativní Windows instalátor. Nejjednodušší cesta je stáhnout Linux binárku do WSL (Windows Subsystem for Linux):

curl -Lo local-ai "https://github.com/mudler/LocalAI/releases/download/v4.1.3/local-ai-v4.1.3-linux-amd64"

chmod +x local-ai

./local-aiPo spuštění otevřete http://localhost:8080 a v galerii modelů si vybraný model stáhnete jedním kliknutím.

Chat

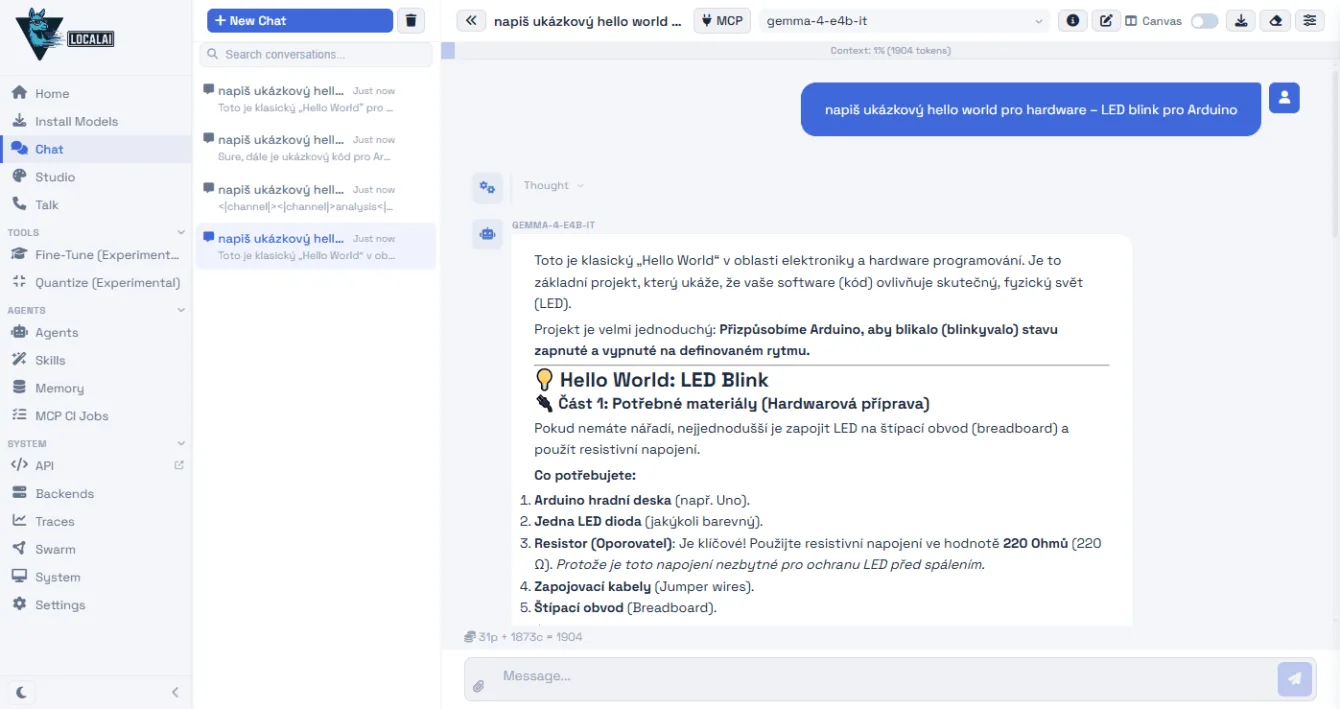

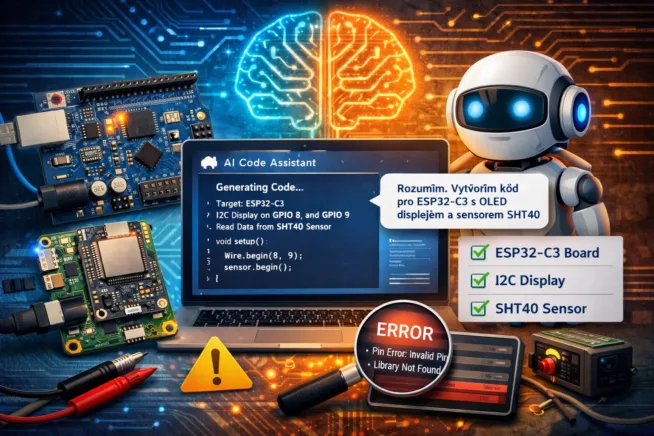

Na promptu „napiš hello world – LED blink pro Arduino“ jsem vyzkoušel tři modely. Všechny odpověděly česky a vygenerovaly funkční kód:

| Model | Rychlost |

|---|---|

| Gemma 4 E4B (Google) | 48 tokenů/s |

| Qwen 3.5 9B (Alibaba) | 18 tokenů/s |

| GPT-OSS 20B (OpenAI) | 14 tokenů/s |

Gemma je nejrychlejší, ale má tendenci odpovídat zbytečně obsáhle a občas vymýšlí krkolomné české překlady technických pojmů. Qwen odpovídá stručně a jeho čeština je ze všech tří nejpřirozenější. GPT-OSS je nejpomalejší a na začátku výstupu občas prosakuje interní „myšlenkový proces“ modelu – pro běžného uživatele matoucí, ale samotný kód je v pořádku. Test proběhl na stroji s grafickou kartou Nvidia RTX 4070 s 12GB VRAM.

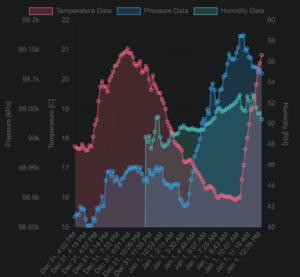

Přepis řeči do textu

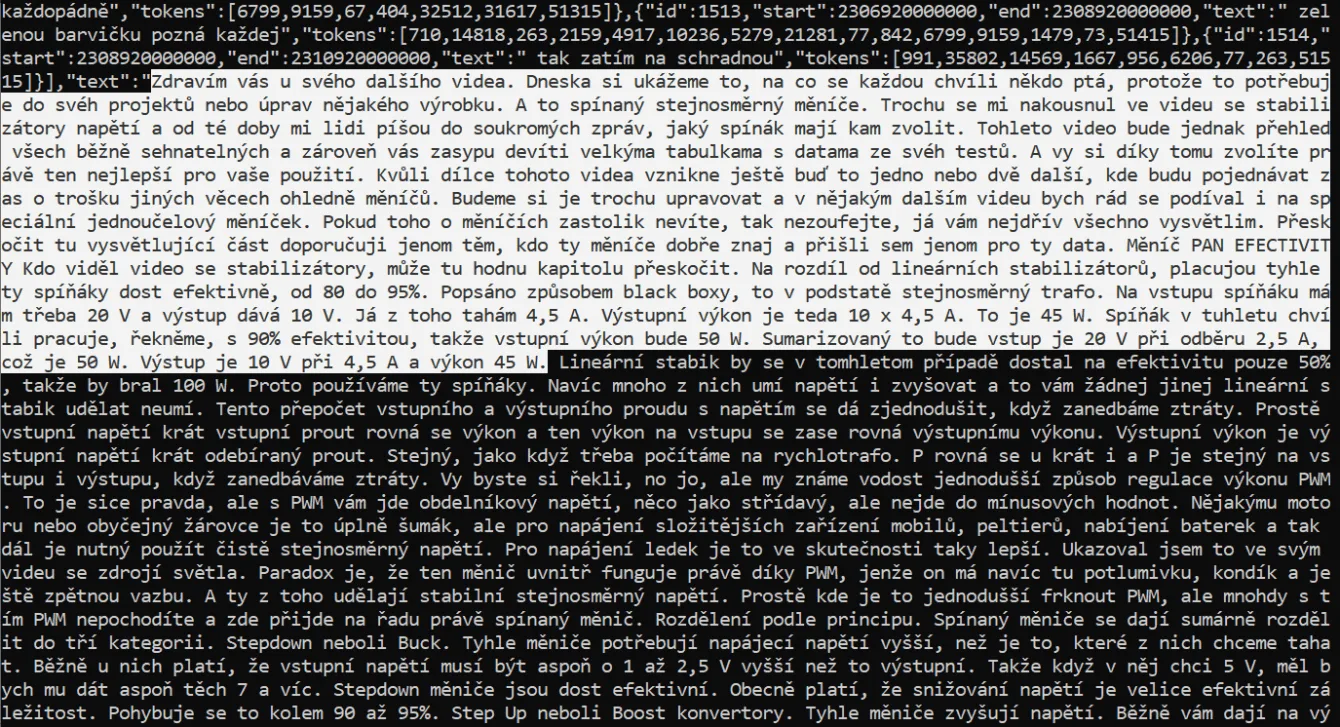

LocalAI umí i přepis audia přes model Whisper Large Turbo. Funguje přes API:

curl http://localhost:8080/v1/audio/transcriptions

-F file="@nahravka.mp3" -F model="whisper-large-turbo"38minutové české video Jiřího Bekra o DC-DC měničích přepsal za minutu a půl. Whisper správně rozpoznal technické termíny (MOSFET, SEPIC, XL4015, LM25116) i hovorovou češtinu. V závislosti na kvalitě audia občas zkomolí nějaké slovo, ale výsledek je velmi použitelný.

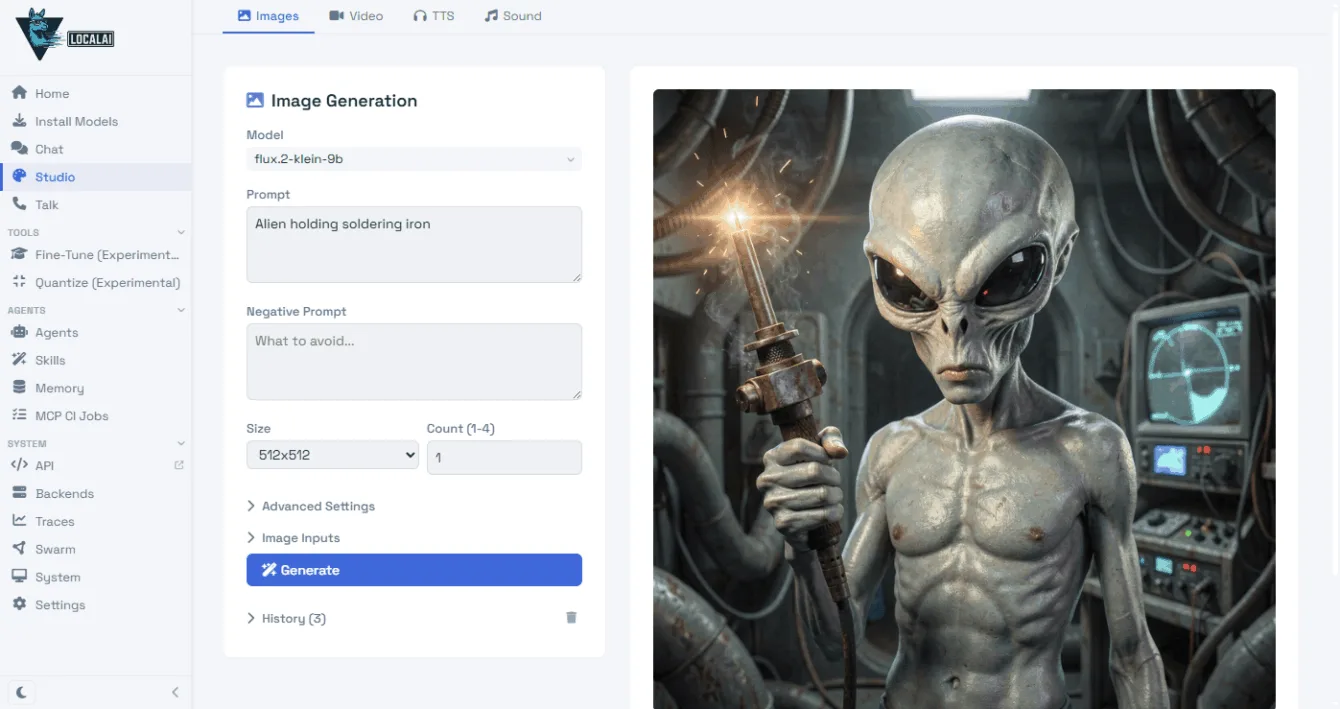

Generování obrázků

LocalAI zvládá i generování obrázků, jen potřebujete vhodný model, například Flux.2-klein-9b.

LocalAI a Ollama

LocalAI není jediná cesta. Ollama má nativní instalátor pro Windows, Mac i Linux – ollama run gpt-oss:20b a chatujete. S webovým rozhraním Open WebUI je to plnohodnotná alternativa k ChatGPT.

Pokud vám stačí chatbot, Ollama je jednodušší. LocalAI se hodí tam, kde chcete víc – text, obraz, zvuk i video v jednom stacku s OpenAI-kompatibilním API. A pokud potřebujete model z Ollama registru, LocalAI si ho stáhne taky (local-ai run ollama://nazev-modelu).

Žádné sociální komentáře k dispozici.